VISUAL ANALYZER

03-180216 中嶋 俊介

① この製品を作るに至った経緯

東京の街を歩いていると、目に様々な広告が目に入り込んでくる。そこでどこで誰がどの広告を見ているのかをデータ化することができれば、どこに何の広告を街の中に配置するのかを知ることができる。そうすれば、広告主にとっても有益な情報となり得、その情報をもとにどこに広告を配置するのが効果的かを知ることができるだろうと考え、この製品を製作した。目にしたものを自動的に解析して、またその見たものがどこで見たものなのかを調べることを目指した。

② 製品の仕組み

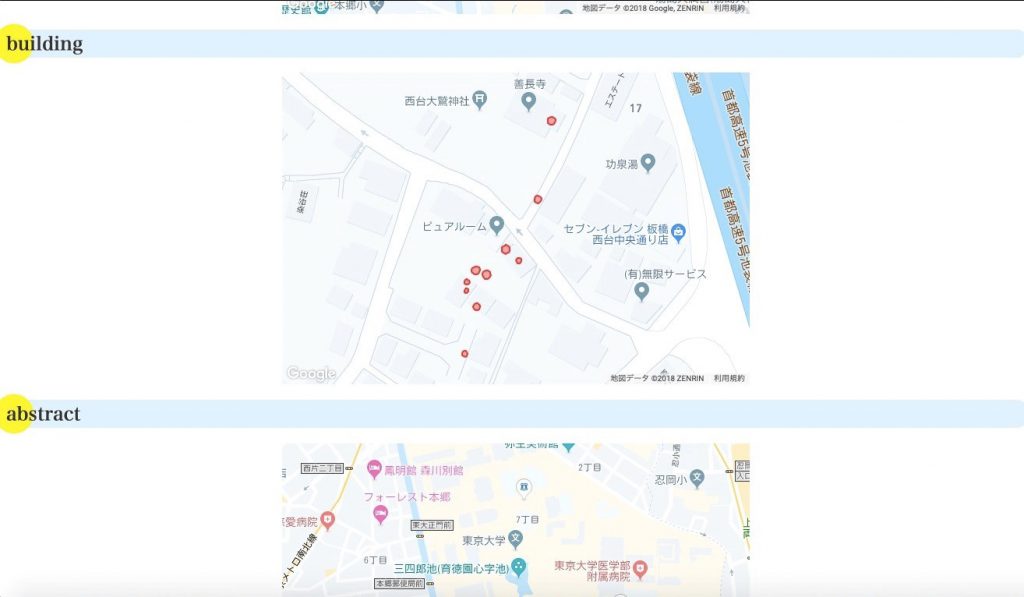

メガネにカメラを取り付けて、それをRaspberry Piと接続することでそれをマイコンとして使用する。Raspberry PiにはGPSセンサを取り付けて、その人のいる場所を特定する。また、Microsoft Azureで、カメラで撮った画像を送ることで何が写っているかを自動認識する。以上により、「どこで」「何を」見たのかを把握することができるので、その情報をGoogle Maps APIに円を描画することで可視化した。

中心がGPS情報から得られた座標で、半径はその検出されたものの信頼度(これはMicrosoft Azureから得られる情報である)として可視化することにした。

実際のRaspberry PiのとGPSモジュール、カメラを繋いだデバイスである。

また、この画像の自動解析とGPSデータを検出して得られる、どこに何があるかというデータを可視化してウェブブラウザ上に表示したものが以下の通りとなる。

また、この画像の自動解析とGPSデータを検出して得られる、どこに何があるかというデータを可視化してウェブブラウザ上に表示したものが以下の通りとなる。

③ 応用例

今回のIoT演習では今回は広告を誰がどこでどれくらい見ているかという点に焦点を当てていたが、今後の応用例としては1つ目としては、どこに何があるかという情報を集めることで逆に見たいものを入力することでお散歩ルートを提案することができる。2つ目としては、各個人に対しても無意識にどの情報を見ているのかをデータとして提示することができる。そのデータによって、Amazonなどのショッピングサイトにおいて、おすすめ商品を提示することができるようになる。3つ目としては、無意識にどの異性に注意を払っているかの情報をこのVisual Analyzerによって検知することができるので、お互いに無意識に意識している人同士を結びつけるマッチングアプリを作り上げることも可能であり、そのようなアプリを作ることが目標でもある。実際には一人ひとりの顔を把握することは現在にMicrosoft Azureでの精度では難しく、一人ひとりの顔検出の精度が上がれば、このようなマッチングアプリを製作することは可能になるであろう。

④ IoT演習で得たもの、学んだもの

このIoT演習でより身をもって感じたことは、今まで簡単に作れるだろうと思っていたものは、思ったよりも製作するのは難しい上、時間がかかるということであった。一つの要求機能を設定すると、その機能を導き出すソフトやハードの設計や製作には、自分がソフトウェアを作るのがあまり経験として無かったということもあり、時間と労力がかかってしまった。しかし、コードを書いていくうちに、PythonやHTML、Java Scriptの学習が進んだので、非常にソフトの勉強になった。サポートしていただいたい教員の方々もソフトについては詳しい方々だったので、遠慮なく質問することができた環境が自分を成長させることができた環境でした。そのような環境を作ってくださった教員の方々には感謝したいです。ありがとうございました。今後もIoT演習で学んだことを今後の、製品や作品を作っていく過程に活かしていきたいと思います。